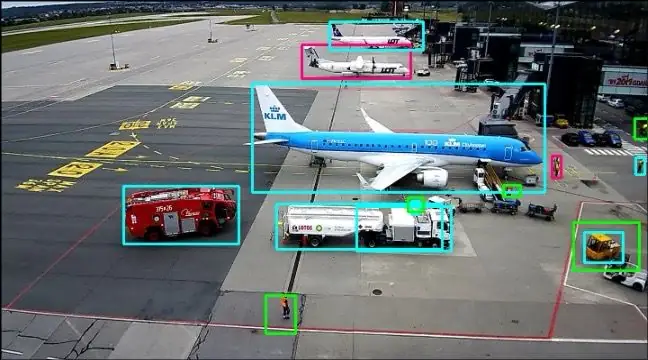

Este estudio, con apoyo de la Consejería de Universidad, puede detectar una gran diversidad de elementos en la zona de pistas.

Este estudio, con apoyo de la Consejería de Universidad, puede detectar una gran diversidad de elementos en la zona de pistas.

Científicos del grupo de investigación Video and Image Processing (VIP) del Departamento de Arquitectura de Computadores de la Universidad de Málaga (UMA) han desarrollado un sistema inteligente de videovigilancia que detecta e identifica en tiempo real objetos y personas en espacios amplios. La novedad de este método es que puede prescindir de la supervisión directa del ojo humano en prácticamente todo el proceso y reforzar las tareas de vigilancia y control. Para demostrar su eficacia, los expertos han probado este modelo en un aeropuerto europeo como escenario real.

Asimismo, otro aspecto clave de este estudio, que cuenta con financiación de la Consejería de Universidad, Investigación e Innovación de la Junta de Andalucía, del Ministerio de Educación y Formación Profesional y de la Universidad de Málaga, es la adaptación del sistema a un dispositivo informático de bajo consumo, es decir, a un procesador de datos más pequeño que los convencionales que requiere poca energía para su funcionamiento.

Hoy en día, los sistemas automáticos de videovigilancia suelen implementar técnicas de detección de objetos como fase inicial antes de realizar tareas más complejas. Requieren la supervisión constante por parte de una persona o un equipo humano para corroborar que el etiquetado e identificación de los elementos se hace de forma correcta.

“Estos modelos se construyen mediante un enfoque de aprendizaje supervisado, donde las imágenes de las clases de objetos, junto con su etiquetado, deben estar disponibles antes del entrenamiento”, explica a la Fundación Descubre Paula Ruiz Barroso, investigadora de la UMA y autora principal del estudio.

Esta supervisión humana exige largos periodos de tiempo, así como recursos materiales y humanos.

“El sistema empleado en este estudio nos permite identificar el movimiento de objetos grandes, como aviones o camiones de bomberos, y al mismo tiempo detectar la presencia de otros más pequeños, como trenes de equipaje, personal trabajador, coches y furgonetas de mantenimiento, requiriendo una supervisión humana mínima”, añade Ruiz.

Más procesado en menos tiempo

Para evaluar el modelo, los expertos proporcionaron al sistema imágenes grabadas en una plataforma de estacionamiento real (área donde los aviones cargan pasajeros y equipaje). Con el fin de reducir el tiempo de procesamiento, optimizaron el algoritmo hasta pasar de 7,4 s por fotograma a 0,2 s por fotograma.

Durante las pruebas se utilizaron modelos de referencia que posteriormente fueron optimizados para medir su impacto en el consumo energético y el tiempo de inferencia (intervalo que necesita la IA para tomar decisiones tras aprender datos nuevos). Los resultados, publicados en Future Generation Computer Systems bajo el título “Real-time unsupervised video object detection on the edge”, demuestran gran precisión, especialmente con objetos pequeños en espacios amplios.

Dispositivo de bajo consumo

Hasta ahora, la complejidad computacional de los modelos convencionales obligaba a procesar los datos en servidores de alto rendimiento. En este trabajo se empleó un dispositivo edge que reduce tiempos y gasto energético, además de garantizar la privacidad al no enviar información a la nube.

“Hemos conseguido disminuir el consumo de 9,6 julios a 0,4 julios —24 veces menos que una bombilla LED de 10 W—”, subraya Ruiz.

Redes sociales Consejería Universidad, Investigación e Innovación

Instagram: @UniversidadAnd – Twitter: @UniversidadAnd – YouTube /UniversidadAnd – LinkedIn /Consejería-Universidad-Investigación-e-Innovación – Facebook /UniversidadAnd